Publikationen Publikationen |

|

In der heutigen industriellen Produktion nimmt die Komplexität der Zusammenarbeit zwischen Mensch und Maschine stetig zu. An hochtechnisierten Industriearbeitsplätzen entstehen immer häufiger kritische Situationen, die zu schweren Arbeitsunfällen führen können. Um diese Situationen zu verhindern und ihre Zahl zu minimieren, sind bereits vielfältige Sicherheitstechnologien im Einsatz. Eine Absperrung des kritischen Bereichs senkt zwar das Gefahrenpotential für die Mitarbeiter, schränkt jedoch auch die erforderlichen Interaktionsmöglichkeiten erheblich ein. Gefragt sind deshalb intelligente, barrierefreie Sicherheitslösungen für den industriellen Bereich, um sowohl sicher als auch gleichzeitig effizient zu automatisieren.

Zur Überwachung von Mensch-Maschine-Arbeitsräumen oder von sicherheitskritischen Bereichen verarbeitet EYE4SAVE Bilder von Stereo-Kamerapaaren, die 3D-Szenarien aus verschiedenen Perspektiven erfassen.

- Mensch-Maschine-Kooperation

3D-Raumüberwachung in Echtzeit

|

|

- Stereo-Kameramodul

|

In der Standardkonfiguration besteht ein EYE4SAVE-System aus vier Stereo-Kamerapaaren, die in den Raumecken montiert sind und den Raum aus "schrägen" Ansichten beobachten. Das System ist je nach Bedarf der konkreten Anwendung erweiterbar bzw. skalierbar.

|

|

|

In Analogie zum menschlichen räumlichen Sehen werden aus jedem der Stereo-Kamerapaare Tiefeninformationen gewonnen.

Diese liefern die Basis, um Objekte in der Werkhalle anhand ihres Abstands zur Kamera vom Hintergrund zu unterscheiden.

Die Wahrnehmung von Objekten im Raum beruht auf der Analyse dieser Tiefeninformationen in Kombination mit aufgenommenen Farbwerten des Hintergrunds.

Als Referenz dient ein im Vorfeld für jedes Stereokamerapaar angelerntes distanz- und farbbasiertes adaptives Hintergrundmodell.

Die aus den verschiedenen Perspektiven erkannten Vordergrund-Objekte werden zusammengeführt und in Form ihrer visuellen Hüllen dreidimensional abgebildet.

Durch das Verbinden einer Vielzahl objektbezogener Eigenschaften aus den unterschiedlichen Ansichten lassen sich Objekte im 3D-Raum vollständig rekonstruieren und je nach dem Bedarf der konkreten Überwachungsaufgabe modellhaft beschreiben.

Speziell dafür entwickelte Verfahren, wie das Fast-Shape-from-Multi-Silhouettes, erlauben so eine 3D-Raumüberwachung in Echtzeit.

|

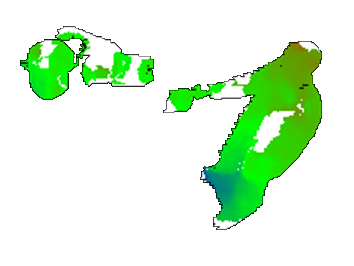

- Distanz-farbcodierte Silhouette einer Kameraperspektive

|

|

|

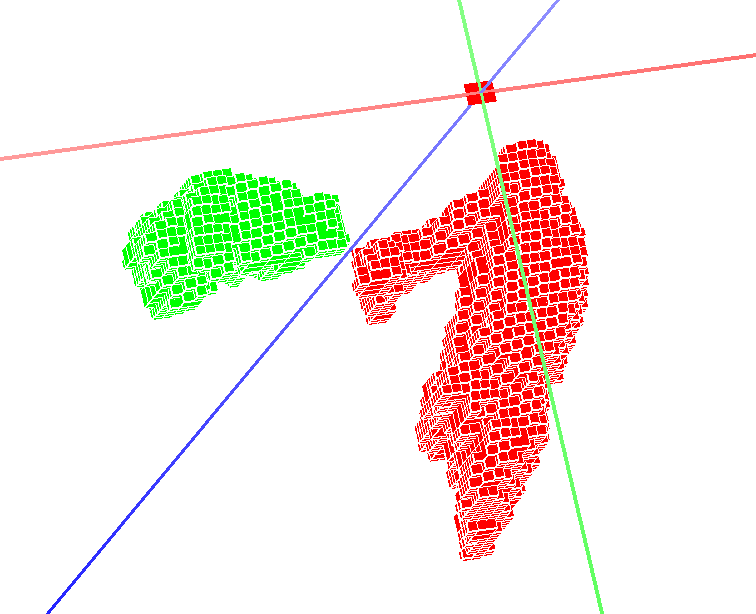

- 3D-Voxelmodell

Je mehr Kameras ein Objekt sehen, desto besser nähern sich die Hüllen der tatsächlichen Objektform an.

Für den Fall, dass eine Kamera ein Objekt nicht komplett erkennt, da es durch andere Objekte verdeckt wird, bleibt die Hülle entsprechend groß.

Dadurch werden Verdeckungen immer zu Gunsten der Sicherheit behandelt. Verdecken sich Objekte gegenseitig, wird der Sicherheitskorridor um ein Objekt automatisch vergrößert.

Höhere Produktivität

Durch den Wegfall von Gehäusen, Lichtschranken und Gittern im Roboterumfeld wird eine maximale Zugänglichkeit zur Arbeitsmaschine ermöglicht, die zu geringeren Standzeiten und einer erhöhten Produktivität des Roboterarbeitsplatzes führen. Durch die Modellierung der Roboter und der im Arbeitsraum befindlichen Personen können die Abstände zwischen Roboter und Mensch präzise berechnet und damit optimal in die Problemlösung und das entsprechende Sicherheitskonzept eingebracht werden. Dadurch hebt sich EYE4SAVE des Zentrums für Bild- und Signalverarbeitung (ZBS) e. V. positiv von anderen kamerabasierten Ansätzen ab, die lediglich grob geformte Sicherheitszonen um den Roboter legen.

|

|

|

Publikationen Publikationen |

Flyer Eye4Save:

Bildbasiertes 3D-Überwachungssystem für die sichere Mensch-Maschine-Kooperationen

|

|

Daniel Kapusi, Rainer Jahn, Rico Nestler und Karl-Heinz Franke:

Eye4Save - visuelle 3D-Überwachung für die sichere Mensch-Maschine-Kooperation.

17. Anwendungsbezogener Workshop zur Erfassung, Modellierung, Verarbeitung und Auswertung von 3D-Daten "3D-NordOst", GFaI Gesellschaft zur Förderung angewandter Informatik e. V. Berlin, S. 123-134, ISBN: 978-3-942709-13-2 .

|

|

Daniel Kapusi, Rico Nestler und Karl-Heinz Franke:

Farbhistogrammgestützte 3D-Objektverfolgung in einem Mensch-Roboter-Überwachungsszenario.

In: Tagungsband 20.Workshop Farbbildverarbeitung. German Color Group, September 2014. ISBN: 978-3-00-047016-5.

|

|

Rainer Jahn, Rico Nestler, Karl-Heinz Franke und Dorit Merhof:

Color-Codebooks zur Vorder- und Hintergrundsegmentierung.

In: Tagungsband 20.Workshop Farbbildverarbeitung. German Color Group, September 2014. ISBN: 978-3-00-047016-5.

|

|

Martin Krawetzke:

Objektbeschreibungen für die 3D-Szenenanalyse am Beispiel einer kamerabasierten Überwachung von Roboterarbeitsplätzen.

Masterarbeit, TU Ilmenau, März 2014. bearbeitet beim ZBS e. V.

|

|

Daniel Kapusi, Martin Klewer und Peter Pharow:

Mehr Sicherheit für die industrielle Robotik.

SPS-Magazin, Seiten 96 - 97, Mai 2013.

|

|

Daniel Kapusi, Philipp Prinke, Darko Vehar, Rainer Jahn, Karl-Heinz Franke und Rico Nestler:

Simultaneous Geometric and Colorimetric Cameracalibration.

In: Tagungsband 16. Workshop Farbbildverarbeitung. German Color Group, Oktober 2010. ISBN: 978-3-00-032504-5.

|

|

Daniel Kapusi, Philipp Prinke, Rainer Jahn, Karl-Heinz Franke und Rico Nestler

Geometric and Colorimetric Calibration For Multiview Camera Adjustments.

In: IWK - 55th. International Scientific Colloquium. TU Ilmenau, September 2010. ISBN: 978-3-938843-53-6.

|

|

|

Grundlegende Forschungs- und Entwicklungsarbeiten zur Thematik "Barrierefreie Mensch-Maschine-Sicherheit" wurden im Rahmen des Verbundprojektes "BildRobo" des Europäischen Fonds für regionale Entwicklung (EFRE) (FKZ 2008FE9063) gefördert, das von der Thüringer Aufbaubank begleitet wurde.

|